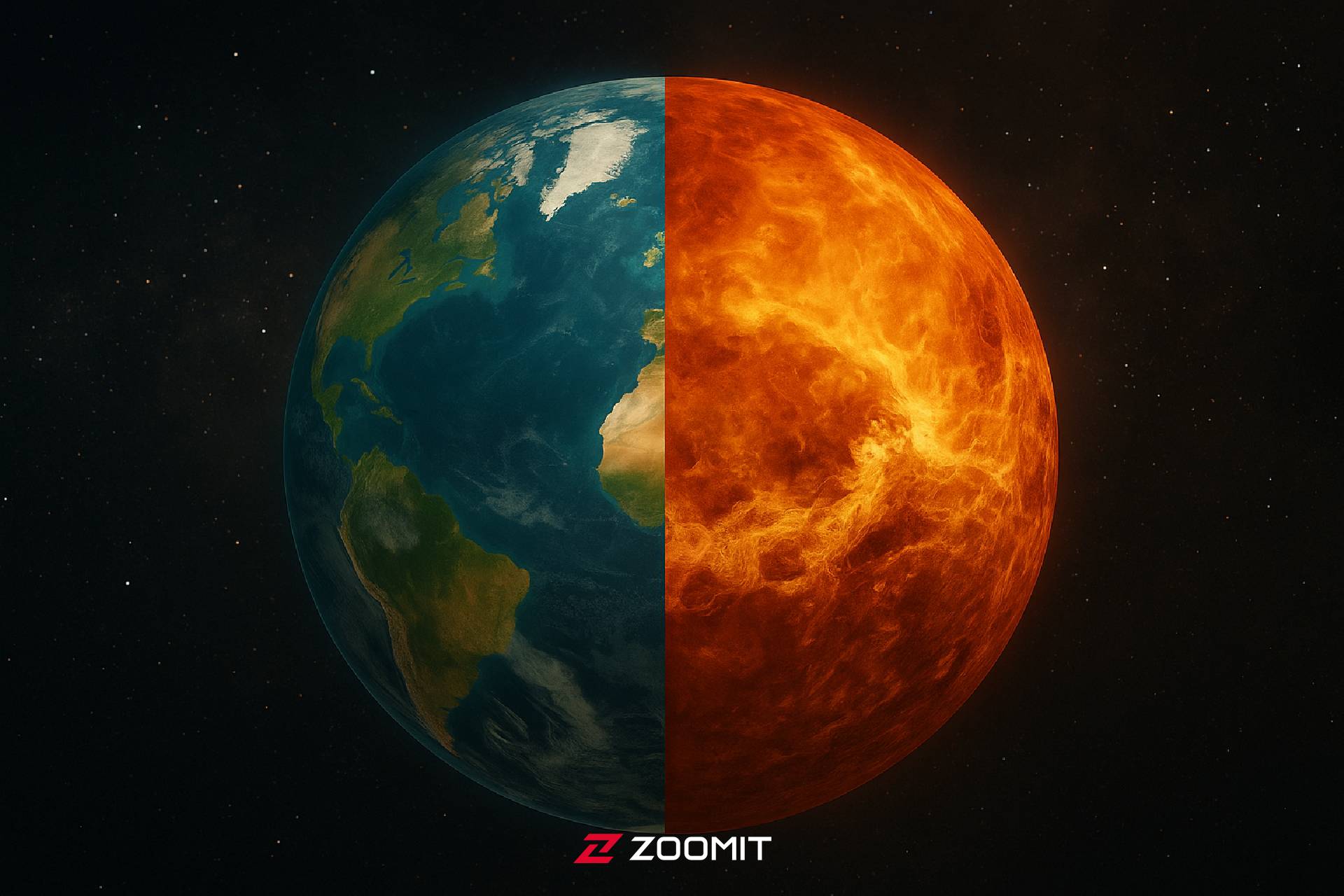

مدل هوش مصنوعی TRM سامسونگ، جمینای و ChatGPT را به چالش کشید

دپارتمان هوش مصنوعی شرکت سامسونگ با معرفی یک مدل نوین، دیدگاه دیرپایی در عرصه فناوری را که معتقد است مدلهای بزرگ به طور طبیعی عملکرد بهتری دارند، به شدت به چالش کشیده است. به تازگی این شرکت جزئیات ساختار یک مدل هوش مصنوعی با نام Tiny Recursive Model یا TRM را افشا کرده است که با وجود ابعاد قابل توجهی کوچکتر، توانسته برخی از بزرگترین مدلهای زبان بزرگ (LLMs) را در آزمونهای استنتاج منطقی به شکست بکشاند.

طبق گزارشات منتشر شده توسط بخش رسانهای توسعه تکنولوژی و فناوری تکنا، این مدل که تنها شامل یک شبکه دو لایه است، با بهرهگیری از یک رویکرد نوآورانه به نام استدلال بازگشتی، خروجیهای خود را برای تعیین فرآیندهای بعدی به کار میگیرد و یک حلقه بازخورد خودبهبود را ایجاد مینماید. این روند به مدل این امکان را میدهد که بدون نیاز به حافظه و محاسبات سنگین، عملکرد یک معماری بسیار عمیقتر را تقلید کرده و به نتایج قابل توجهی دست یابد.

عملکرد چشمگیر مدل TRM سامسونگ در آزمونهای چالشزا مانند معماهای سودوکو-اکسترم و ماز-سخت و به ویژه در بنچمارک معتبر ARC-AGI به اثبات رسیده است. این مدل توانسته دقت ۸۷.۴ درصدی را در حل سودوکو و ۸۵ درصدی را در پازلهای پیچیده ماز محقق کند. از همه مهمتر، TRM در آزمون ARC-AGI-1 به دقت ۴۵ درصد و در نسخه چالشبرانگیزتر یعنی ARC-AGI-2 موفق به کسب دقت ۸ درصد شده است.

این نتایج به جهت اهمیت زیادی که دارند، نشان میدهند که مدل TRM به طرز قابل توجهی از رقبای بزرگتر خود مانند DeepSeek R1 و Gemini 2.5 Pro گوگل و o3-mini شرکت OpenAI پیشی گرفته است، در حالی که تنها بخش کوچکی از پارامترهای آنها را به کار میگیرد. این موفقیت به خوبی نشان میدهد که رویکرد سامسونگ، مشابه بازخوانی و ویرایش یک پیشنویس انسانی، در حل مسائل منطقی بسیار موثرتر از رویکردهای رایج عمل میکند.

این دستاورد سامسونگ پیامی واضح برای صنعت هوش مصنوعی دارد: سادگی و کارایی میتواند بر پیچیدگی و ابعاد غالب شود. مدلهای زبان بزرگ کنونی غالباً در برابر مسائل منطقی آسیبپذیر هستند و یک خطای کوچک در زنجیره استدلال میتواند کل فرآیند را مختل کند.

در عوض، روش بازگشتی مدل TRM با تکرار و اصلاح مستمر، این عیب را رفع مینماید. محققان سامسونگ متوجه شدند که افزایش لایههای این مدل به خاطر پدیده بیشبرازش یا overfitting باعث کاهش عملکرد آن میشود که این رویداد خود گواهی بر اصل “کمتر، بیشتر است” در این ساختار خاص میباشد. موفقیت TRM ثابت میکند که الگوریتمهای هوشمندتر و بهینهتر میتوانند به جای قدرت محاسباتی خام قرار گیرند و مسیر آینده توسعه هوش مصنوعی را به سمت مدلهای تخصصی و کارآمدتر رهنمون سازند.